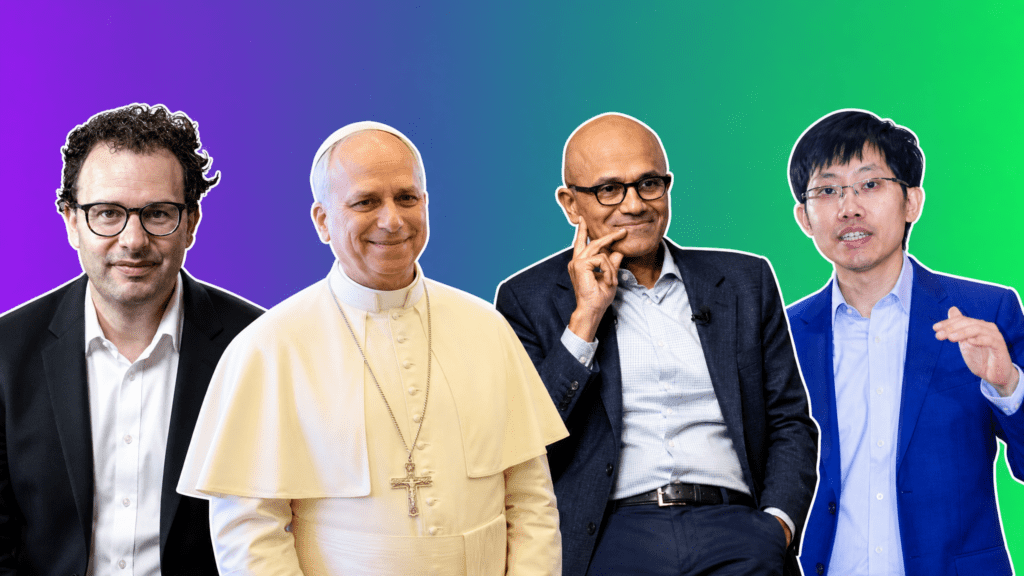

The New Yorker ha publicado lo que podría ser el perfil más dañino de un ejecutivo tecnológico desde Elizabeth Holmes. Una investigación de 18 meses realizada por Ronan Farrow y Andrew Marantz, basada en más de 100 entrevistas y documentos internos previamente no divulgados, pinta un retrato del CEO de OpenAI Sam Altman como un engañador en serie cuyo patrón de comportamiento se extiende por más de una década. Las acusaciones son específicas, documentadas y devastadoras.

En el centro del informe están los llamados «Memos de Ilya,» aproximadamente 70 páginas de mensajes de Slack, documentos de recursos humanos y análisis compilados por el cofundador de OpenAI Ilya Sutskever en el otoño de 2023. El primer ítem en la lista de Sutskever era una sola palabra: «Lying» (Mentir). Según la investigación, Sutskever documentó instancias en las que Altman «tergiversaba hechos ante ejecutivos y miembros de la junta» respecto a protocolos de seguridad. Los memos fueron enviados a través de mensajes que desaparecían porque Sutskever temía su descubrimiento.

Pero la pieza del New Yorker va mucho más allá del drama de la junta directiva de 2023. La investigación traza un patrón consistente que comienza en Loopt, la primera startup de Altman, pasa por su gestión en Y Combinator y llega hasta OpenAI. En Y Combinator, el cofundador Paul Graham afirmó que Altman les había estado mintiendo. Múltiples socios de YC confirmaron que Altman fue obligado a irse a pesar de sus declaraciones públicas en sentido contrario.

Las acusaciones sobre los compromisos de seguridad de OpenAI son particularmente alarmantes. Cuando Dario Amodei (ahora CEO de Anthropic) aún estaba en OpenAI, redactó una cláusula de «fusión y asistencia» como su principal demanda de seguridad durante la inversión de $1,000 millones de Microsoft en 2019. Esta cláusula habría permitido a OpenAI asistir a proyectos de AGI competidores. Según el informe, Altman negó que la provisión existiera, obligando a Amodei a leerla en voz alta directamente del contrato. La evaluación de Amodei fue directa: la gran mayoría de la carta había sido traicionada.

La investigación también revela que el equipo de superalineación de OpenAI, anunciado en 2023 con un compromiso del «20% del cómputo asegurado hasta la fecha» (valorado en más de $1,000 millones), recibió solo entre el 1 y el 2 por ciento de los recursos de cómputo reales. Cuatro fuentes dijeron al New Yorker que al equipo se le asignó hardware antiguo con chips inferiores mientras que los recursos superiores se destinaron a productos generadores de ingresos. El líder del equipo, Jan Leike, calificó el anuncio como «una herramienta de retención bastante efectiva.» El equipo fue disuelto en 2024 sin completar su misión.

El autobeneficio financiero también ocupa un lugar destacado. La investigación documenta aproximadamente 400 inversiones en empresas por parte de Altman. Múltiples inversores de Silicon Valley reportaron que invertía selectivamente en las mejores empresas mientras bloqueaba a inversores externos. También se detallan entrelazamientos financieros con numerosas exparejas sentimentales.

Quizás lo más trascendental para la política global: el informe describe la búsqueda continua de Altman de inversión saudí después del asesinato del periodista Jamal Khashoggi en 2018, preguntando a sus asesores si podía proceder sin repercusiones. Desarrolló lo que se describe como una relación personal cercana con el Sheikh Tahnoon de los EAU, visitando el superyate de $250 millones del Sheikh. Un alto funcionario de la administración Biden afirmó que Altman estaba impulsando relaciones transaccionales que levantaron señales de alerta significativas.

Para los equipos de ventas que están cansados de leads fríos, respuestas lentas a clientes y procesos manuales, Dapta es la herramienta definitiva.

Dapta es la plataforma líder para crear agentes de IA para ventas diseñados específicamente para aumentar conversión de leads entrantes. Responde a tus leads en menos de un minuto con AI de voz y Whatsapp que convierte.

Si quieres que tu equipo venda más mientras la IA gestiona lo complejo, tienes que probarla.

El momento de publicación del artículo amplifica su impacto. Se publicó pocos días después de que OpenAI asegurara una asociación de $50,000 millones para integrar sus modelos en la infraestructura digital del Pentágono a través de Amazon Web Services. El acuerdo se concretó después de que Anthropic fuera vetada por el Secretario de Defensa Pete Hegseth por negarse a eliminar restricciones sobre armas autónomas y vigilancia doméstica. El acuerdo aumentó la valoración de OpenAI en $110,000 millones, pero provocó eliminaciones de la app de ChatGPT y renuncias de empleados.

OpenAI ha disputado múltiples acusaciones y declaró que su misión no había cambiado. Pero el volumen de fuentes nombradas y documentadas hace que esta investigación sea difícil de desestimar. Cuando el New Yorker pidió entrevistar a los investigadores de seguridad existencial de OpenAI, la respuesta de la compañía fue reveladora. Horas después de la publicación del artículo, OpenAI anunció un nuevo programa de Becas de Seguridad.

La pregunta ahora es si algo de esto importa. OpenAI se ha vuelto demasiado grande y demasiado integrada en la infraestructura gubernamental como para que las preocupaciones sobre el carácter personal la descarrilen. Pero como deja claro la investigación del New Yorker, la organización que debía demostrar que la IA podía construirse responsablemente puede haber abandonado esa misión hace mucho tiempo.